在2026年中国家电及消费电子博览会(AWE 2026)上,声网对话式AI开发套件R全系列产品与“泛IPC实时交互+智能处理引擎”正式亮相,并携数十款搭载其技术的明星硬件产品组,向业界展示了其决定硬件交互体验的关键角色。

要在物理世界实现真正的智能,硬件不仅需要大模型作为“大脑”,更需要一套实时交互的“神经系统”。

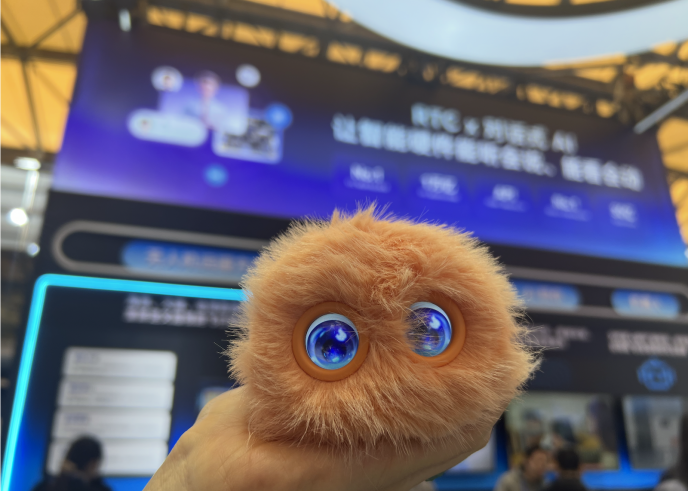

在本届AWE上,声网R2 全场景AI机器人开发套件原型机首次亮相。R2在继承全双工语音优势的基础上,新增了本地视觉识别与多自由度运动控制,实现了从“能听会说”到“能看会动”的跨越。它能“看懂”手势、识别人脸轨迹,甚至实现“走到你面前打招呼”或“转头注视说话者”这类充满生命感的本能反应。这种“被看见”和“被注视”的体验,让AI从一个简单应答的硬件,进化成了有灵性的陪伴者,为后续复杂场景落地提供了标准化的“技术基座”。

技术的演进最终落脚于用户体验的变迁。在声网展台上,这种变迁直观地表现为产品形态的进化。

在AWE上亮相的陆卡卡代表了全新的物种。作为搭载R2套件的桌面级情感机器人,陆卡卡不再被动等待对话。当你走近它时,它会转头凝视你;当你指向某处,它能循声辨位。这种“被注视”的体验,将人机交互从“命令-响应”的机械流程,推进到了“感知-共鸣”的情感层面。

从“能听会说”到“能看会动”,随着运动控制算法与端侧多模态模型的进一步融合,具身智能将是声网的下一站。

今年年初,声网宣布了一项具有行业战略意义的举措:将核心的硬件抽象层项目AOSL在GitHub全面开源。AOSL在操作系统、芯片与RTC传输层之间定义了一套标准接口,屏蔽了底层FreeRTOS、Linux与不同芯片型号之间的差异。对于芯片厂商而言,接入AOSL意味着其硬件从出厂即具备了“声网级”的实时互动能力。

本次AWE上声网首次展现了最新的开源生态,这种“开源底座+商业套件”的模式,正在吸引越来越多芯片伙伴加入生态,将硬件的创新模式从过去的“一次性定制”推向了“可复用、可扩展”的生态协作。

如果说对话式AI开发套件解决的是“如何让硬件更智能”的问题,那么声网同步发布的“泛IPC实时交互+智能处理引擎”,则直面“如何让海量IoT设备在全球范围内稳定连接、实时交互”的刚需。

对于摄像头、扫地机器人、3D打印机、宠物喂食器等设备,用户的期待早已不是“能远程看一眼”这么简单。在海外也能秒速打开家里的监控;在弱网环境下扫地机依然听指挥;在宠物异常时第一时间收到提醒;在3D打印过程中实时掌控进度。这些期待的背后,是对实时交互能力与端云协同AI的双重考验。

声网该解决方案集成四大核心能力:第一是全球覆盖,秒见图;第二是弱网不断连,延迟稳定可控;第三是端云协同AI,让设备“会思考”;第四是多端互通+安全合规,为全球化扫清障碍。回顾这十年变迁,无论是APP还是硬件,形态终将更迭,但人类通过最自然的语言与机器交互的诉求是永恒的。

当AI硬件从“功能机”向“情感机”、“智能体”进化,实时互动体验的优劣将成为决定产品生死的关键。作为全球实时音视频云服务的开创者,声网始终致力于为人与人、人与Agent、Agent与Agent的多模态实时交互提供最佳体验。通过对话式AI开发套件的一代代升级、通过AOSL开源生态的构建、通过泛IPC解决方案的全球部署,声网正在将复杂的实时互动能力标准化、模块化,为整个行业铺设通往万物智联时代的底层通路。